Edgee

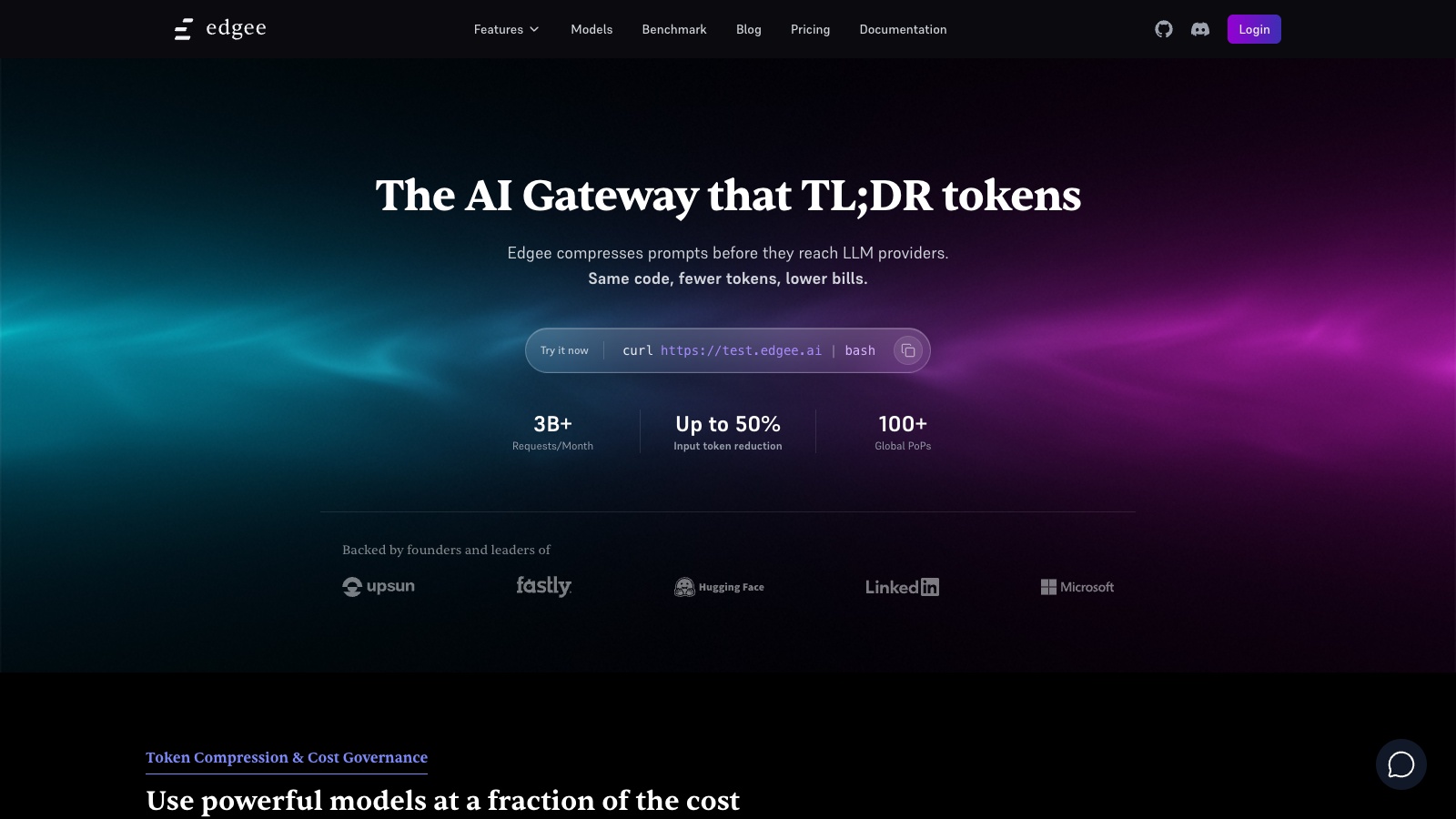

边缘压缩+智能路由,一键聚合多模型,LLM调用成本立降50%

网站介绍

【基本信息】

- 语言支持:英文为主,SDK 提供 TypeScript、Python、Go、Rust 示例

- 价格模式:按请求量计费,含免费试用额度;支持自带 API Key(BYOK)

- 适用平台:任何可调用 HTTP/HTTPS 的环境(Web、移动端、服务器、边缘函数)

- 访问方式:在线接入,一行 curl 脚本即可体验;提供 OpenAI 兼容的单一端点

- 其他特色:全球 100+ PoP 边缘节点,SOC 2 & GDPR 合规,月处理 30 亿次请求

【功能与特色】

智能 Token 压缩

在请求抵达 LLM 之前,于边缘节点实时剔除冗余词汇、合并重复语义,最长上下文、RAG 载荷与多轮对话可缩减 50% 输入 token,直接降低账单并缩短首字延迟。压缩算法保持原始意图与结构化信息不变,无需改写业务代码,兼容 OpenAI、Anthropic、Gemini、xAI、Mistral 等全部主流模型。

统一网关与弹性路由

单一 OpenAI 格式端点聚合多家上游,自动归一化响应字段,使模型切换、A/B 测试与故障转移在秒级完成。可配置路由策略:按成本、延迟、速率限制或区域合规要求动态挑选最佳供应商,并支持边缘级重试与缓存,保障高并发场景下的稳定与性能。

成本治理与可观测性

为每条请求打上自定义标签(团队、功能、项目),实时追踪 token 消耗、压缩节省金额、模型级支出与单请求成本;内置异常检测,当某标签 24h 花费超阈值即触发告警,提前防止预算失控。仪表盘提供端到端延迟、错误率、重试次数等全链路指标,帮助工程师快速定位性能瓶颈。

边缘工具与私有模型

平台托管常用工具(PII 脱敏、翻译、风控)并支持用户部署自定义无服务器函数,就近执行降低往返延迟。同时提供一键式边缘部署开源 LLM,生成专属私有端点,与公有模型共用同一网关 API,满足数据不出境、行业合规或个性化微调需求。

【一句话总结】

Edgee 用边缘压缩与智能路由把 LLM 调用成本砍半,为开发者提供“一个端点、多家模型、全程可观测”的 AI 网关,让规模化 AI 功能既快又省。

网站截图