CLIP Interrogator

反向学习!从图片反推AI关键词

网站介绍

【基本信息】

- 语言支持:英文界面,提示词输出支持多语言描述

- 价格模式:按次计费≈$0.00057/次,新用户有免费额度;开源可本地 Docker 部署

- 适用平台:Web 浏览器,无需安装

- 访问方式:GitHub 账号一键登录,在线上传图片即刻运行,提供 Playground、API、Node.js 与 Python SDK

【功能与特色】

1. 反向提示词生成

融合 OpenAI CLIP 与 Salesforce BLIP,对上传图像进行多维度语义解析,自动输出 Stable Diffusion 1.x/2.x/XL 可直接复用的完整提示词,包含主体、风格、艺术家、色调、构图等关键词,实现“以图生文”的零门槛逆向工程。

2. 多模型 backbone 与速度模式

提供 ViT-L-14、ViT-H-14、ViT-bigG-14 三种 CLIP 主干,分别对应 SD 1、SD 2、SDXL 系列,精准匹配不同模型特征;内置 best/fast/negative 四档模式,best 模式 10–20 秒深度挖掘细节,fast 模式 1–2 秒极速出词,兼顾质量与效率。

3. 低成本云算力与开源可迁移

单次运行成本低于 0.06 美分,1750 次仅需 1 美元;代码与权重完全开源,支持本地 GPU/Docker 离线运行,数据隐私与成本控制双保险,适合个人创作者、企业数据集标注及大规模风格迁移流水线。

【一句话总结】

用一张图秒出 SD 级精准提示词,最低成本打通“图像→提示→再创作”全链路。

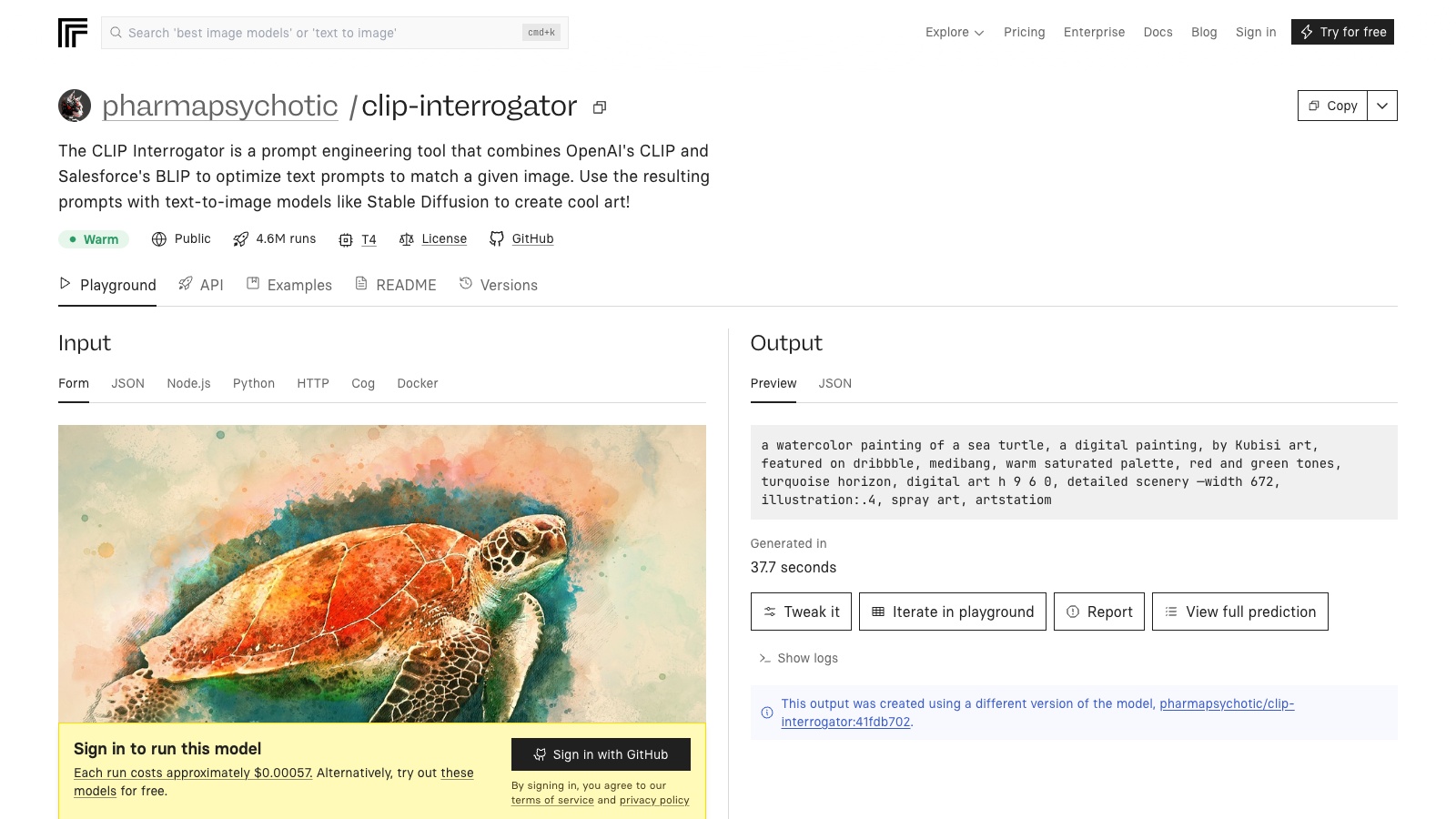

网站截图